Détails de la leçon

Description de la leçon

L’intelligence artificielle générative révolutionne la création de contenus textuels, mais son adoption soulève d’importantes questions de fiabilité. L’un des risques majeurs, souvent sous-estimé, réside dans ses hallucinations : il s’agit d’informations inventées présentées comme certaines, telles que des références scientifiques fictives, des lois inexistantes ou des dates historiques erronées. Cette leçon analyse l’origine technique du phénomène : la génération de texte plausible sur la base de probabilités, sans véritable compréhension ni validation des faits.

Pour l'utilisateur, en particulier dans un cadre professionnel (contrats, études, analyses juridiques, etc.), ces dérives peuvent être préjudiciables. Ainsi, la leçon fournit des stratégies défensives : formulation de prompts stricts, exigence de réponses cadrées, invitation explicite à l’IA de déclarer son incertitude en cas de doute. Des exemples concrets sont traités, illustrant comment forcer l’IA à refuser de répondre devant une question infondée et exiger la citation de sources vérifiables.

Enfin, des astuces d’expert sont partagées, comme l’ajout systématique d’une demande de relecture critique et de listing des références en fin de prompt. À travers ces bonnes pratiques, les utilisateurs deviennent capables de sécuriser et fiabiliser leurs interactions avec l’IA, réduisant de façon significative le risque d’hallucination dans leurs pratiques professionnelles et personnelles.

Objectifs de cette leçon

À l’issue de cette vidéo, le spectateur saura :

- Identifier les hallucinations d’un outil d’IA générative

- Comprendre leurs causes et leur impact

- Mettre en place des stratégies pour limiter les erreurs inventées

- Rédiger des instructions robustes afin d’obtenir des réponses fiables et référencées

Prérequis pour cette leçon

Pour bénéficier pleinement de cette leçon, il est conseillé d’avoir :

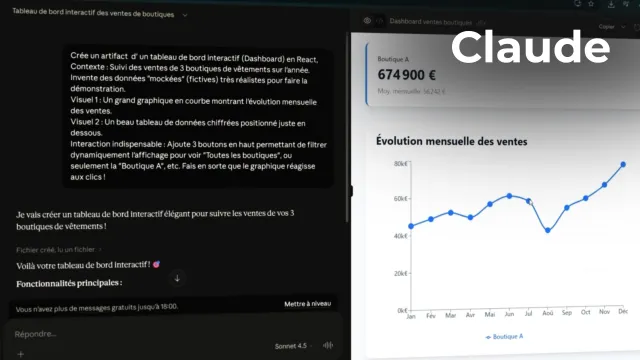

- Une première expérience de l’utilisation d’IA générative (ChatGPT, Claude, etc.)

- Une connaissance basique de l’IA et de ses limites

- Des notions de vérification de sources d’information

Métiers concernés

La gestion des hallucinations IA concerne particulièrement les métiers suivants :

- Juriste: sécurisation des rédactions contractuelles

- Responsable communication & contenu

- Chef de projet digital

- Chercheur ou analyste

- Formateur numérique, en particulier sur l’intégrité de l’information

Alternatives et ressources

En dehors de Claude, d’autres IA génératives ou plugins existent pour la génération fiable de contenu, tels que :

- OpenAI ChatGPT (avec paramètres de vérification renforcés)

- Google Gemini

- Bing Copilot

- Perplexity AI avec citations automatiques

Utiliser ces alternatives en complément de méthodes de fact-checking manuel.