Détails de la leçon

Description de la leçon

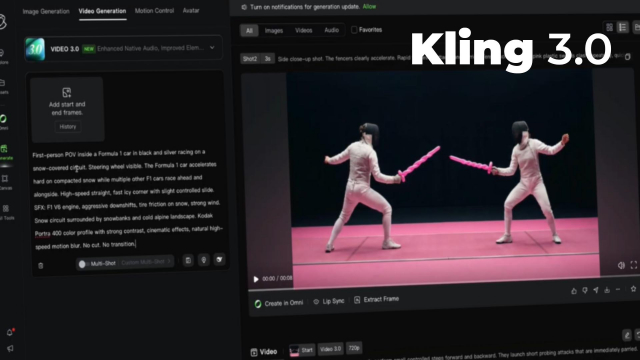

Cette vidéo présente un tutoriel avancé sur la fonction Transformation d’Omni, un outil puissant permettant de modifier en profondeur des vidéos générées ou existantes. Grâce à l’intégration simultanée d’une vidéo source et d’une image de référence, l’utilisateur peut transformer le style, le contexte, ou remplacer un personnage tout en précisant ses intentions par prompt.

L’auteur guide l’utilisateur à travers plusieurs exemples concrets :

- Remplacement ciblé d’un personnage dans la scène (ex : substituer un individu par un personnage stylisé et immobile, comme Anna), tout en gardant posture, dynamique et mouvement de caméra.

- Transformation stylistique complète, par exemple en passant une séquence dans un style bande dessinée ou concept art, tout en conservant l’audio originel et la synchronisation sonore.

- Changement de contexte d'une scène, où l'environnement initial est troqué contre celui d'un métro en gardant l’action et les éléments clés comme les flammes, avec un contrôle précis via le prompt.

La leçon insiste sur l’importance de tester d’abord sur de courtes séquences (4 secondes) pour valider le rendu et économiser des crédits, la gestion des artefacts courants (visages, superpositions, mouvements rapides), et l’importance d’une rédaction explicite des prompts pour garantir la fidélité des éléments souhaités.

Des conseils pratiques et retours sur les défauts potentiels (artefacts, accélérations, anomalies durant la génération) permettent à l’utilisateur de perfectionner ses propres essais, tout en découvrant la valeur ajoutée du maintien de l’audio sur les versions stylisées.

En somme, ce tutoriel synthétise une approche méthodique pour maximiser le potentiel créatif de la transformation vidéo par IA dans Omni, tout en contournant les limites techniques et esthétiques actuelles de ce type de solution.

Objectifs de cette leçon

À la fin de cette vidéo, vous serez capable de :

- Utiliser efficacement la fonction Transformation dans Omni pour modifier une vidéo existante grâce à des images de référence et des prompts.

- Remplacer des éléments visuels ou modifier le style global d’une vidéo.

- Adapter le contexte et l’esthétique d’une séquence tout en conservant mouvements, gestuelle et audio.

- Identifier et limiter les artefacts courants lors des transformations par IA.

- Formuler des prompts précis pour garantir un rendu conforme à vos attentes.

Prérequis pour cette leçon

Il est recommandé de posséder :

- Une connaissance basique du logiciel Omni ou d’outils similaires.

- Des notions en édition vidéo et manipulation de fichiers vidéo/image.

- Une capacité à rédiger des prompts détaillés en français ou en anglais pour guider l’IA.

Métiers concernés

Ce sujet intéresse :

- Les motion designers

- Les réalisateurs de contenus digitaux

- Les artistes 3D/2D

- Les professionnels du marketing vidéo

- Les enseignants en multimédia ou création visuelle

- Les community managers recherchant des effets visuels innovants

Alternatives et ressources

Des solutions alternatives incluent :

- Kling

- Runway (Gen-2 Video)

- Pika Labs

- Stable Video Diffusion

- Adobe Firefly (pour des styles limités)