Détails de la leçon

Description de la leçon

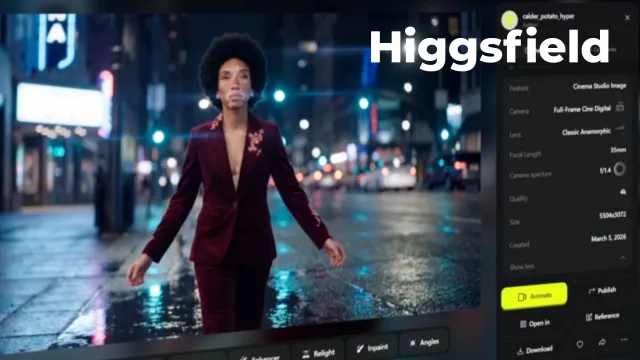

Cette leçon aborde en détail la problématique des dérives inévitables dans la génération d'images par intelligence artificielle non déterministe. Il est expliqué que, même en soumettant un même prompt avec le même identifiant (soul ID), des variations apparaissent inévitablement.

L’analyse s’effectue à partir d’exemples concrets, tels que la disparition de motifs de vitiligo ou l’altération de caractéristiques faciales, illustrant les limites actuelles de la technologie. Sont abordées les bonnes pratiques : identification précise des écarts, réactivation de l’ID de référence, et renforcement de la description physique pour garantir la cohérence visuelle et conceptuelle.

La vidéo souligne l’importance d’une description détaillée, notamment sur la lumière, la disposition et la présence de caractéristiques spécifiques, pour pallier les incohérences générées par l’IA. L’approche adoptée n’est pas de viser une automatisation parfaite, mais d’apprendre à accompagner et guider l’outil en cas de « dérive », évitant la sur-interprétation ou la perte de contrôle sur le rendu final.

Enfin, l’intervention met en lumière la nécessité d’un œil critique pour détecter les modifications non naturelles et réajuster les paramètres prompt ou les instructions, afin d’obtenir un résultat pertinent, professionnel, et fidèle au besoin initial.

Objectifs de cette leçon

L’objectif principal est d’apprendre à identifier les dérives produites lors de la génération d’images par IA, de comprendre comment analyser ces variations, et d’acquérir des méthodes correctrices (ré-activation d’ID, descriptifs renforcés, précisions techniques) pour optimiser la cohérence et l’exactitude du rendu. La vidéo vise également à développer une approche critique du prompt engineering et à encourager une posture proactive face aux aléas de l’automatisation créative.

Prérequis pour cette leçon

Il est nécessaire de maîtriser les bases de l’intelligence artificielle générative, de connaître le fonctionnement des prompts et des identifiants de style (soul ID), ainsi que de posséder une sensibilité à la composition et aux variations visuelles dans la création d’images numériques.

Métiers concernés

Les principaux métiers concernés sont : graphistes, illustrateurs numériques, concepteurs en identité visuelle, photographes retoucheurs, directeurs artistiques, mais aussi chercheurs en IA générative et professionnels de l’animation ou studios de création d’image numérique.

Alternatives et ressources

Parmi les alternatives, on retrouve des solutions comme Stable Diffusion, DALL·E, Adobe Firefly ou des méthodologies avancées de prompt engineering et de contrôle de la génération, permettant un ajustement fin du style et des variations, ainsi que l’utilisation de scripts de correction automatisée pour la stabilité d’image.